Meta新注意力机制突破Transformer上限,还用上了OpenAI的开源技术

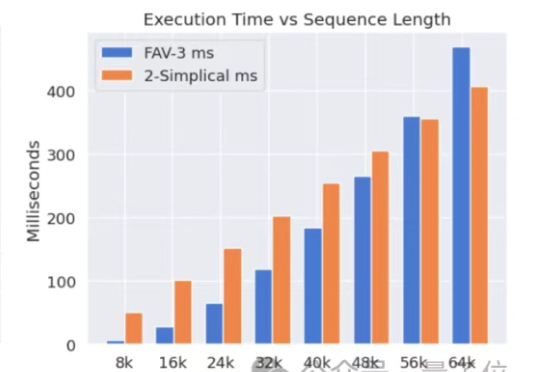

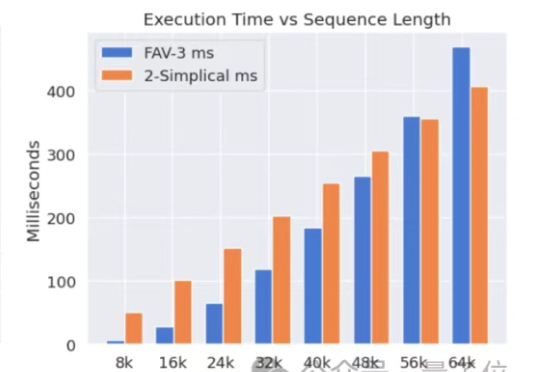

Meta新注意力机制突破Transformer上限,还用上了OpenAI的开源技术Meta挖走OpenAI大批员工后,又用OpenAI的技术搞出新突破。新架构名为2-Simplicial Transformer,重点是通过修改标准注意力,让Transformer能更高效地利用训练数据,以突破当前大模型发展的数据瓶颈。

来自主题: AI技术研报

7815 点击 2025-07-08 12:01

Meta挖走OpenAI大批员工后,又用OpenAI的技术搞出新突破。新架构名为2-Simplicial Transformer,重点是通过修改标准注意力,让Transformer能更高效地利用训练数据,以突破当前大模型发展的数据瓶颈。